正如图像处理、智能医疗、自动驾驶汽车和智慧城市等人工智能(AI)各个领域的突破所证明的那样,这无疑是深度学习的黄金时期。在接下来的十年左右,人工智能和计算系统最终将具备像人类一样学习和思考的能力——处理持续的信息流并与现实世界互动。

然而,当前的AI模型在连续接受新信息训练时会遭受性能损失。这是因为每次生成新数据时,都会将其写入现有数据之上,从而擦除以前的信息。这种效应被称为“灾难性遗忘”。稳定性-可塑性问题带来了一个困难,即AI模型需要更新其记忆以不断适应新信息,同时保持其当前知识的稳定性。这个问题阻止了最先进的人工智能不断地从现实世界的信息中学习。

边缘计算系统允许将计算从云存储和数据中心转移到原始源附近,例如连接到物联网(IoT)的设备。在资源有限的边缘计算系统上有效地应用持续学习仍然是一个挑战,尽管已经提出了许多持续学习模型来解决这个问题。传统模型需要高计算能力和大内存容量。

新加坡科技设计大学(SUTD)的一组研究人员最近设计了一种用于实现节能持续学习系统的新型代码,这些研究人员包括Shao-XiangGo、WangWang、BoWang、YuJiang和娜塔莎·巴哈洛维奇。该团队由首席研究员、来自SUTD的助理教授DesmondLoke领导。这些研究人员的研究“电阻开关存储器材料中的持续学习电导”发表在《高级理论与模拟》杂志上。

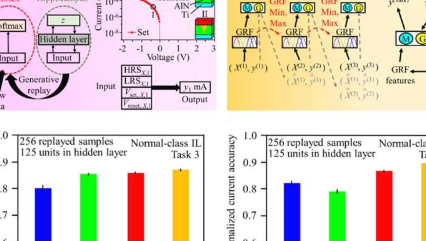

该团队提出了Brain-InspiredReplay(BIR),这是一种受大脑启发的模型,可以自然地进行持续学习。BIR模型基于人工神经网络和变分自编码器的使用,模仿人脑的功能,在不存储数据的情况下可以在类增量学习情况下表现良好。研究人员还使用BIR模型来表示在数字存储系统中使用电流的导电细丝生长。

“在这个模型中,知识被保存在经过训练的模型中,以便在引入额外任务时最大限度地减少性能损失,而无需参考以前工作的数据,”助理教授Loke解释说。“所以,这为我们节省了大量的能源。”

“此外,在不存储数据的情况下,在挑战当前学习任务的合规性方面实现了89%的最新准确率,这比传统的持续学习模型高出约两倍,并且能源效率高,”“他加了。

为了让模型能够独立处理现实世界中的现场信息,团队计划在下一阶段的研究中扩展模型的可调能力。

“基于小规模示范,这项研究仍处于早期阶段,”助理教授洛克说。“采用这种方法有望让边缘人工智能系统在没有人为控制的情况下独立发展。”